кё°м–өмқ„ мһғмқҖ мқёкіөм§ҖлҠҘ

- мқёкіөм§ҖлҠҘмқҙ мҠӨмҠӨлЎң л¶ҖнҢЁн•ҳлҠ” мӢңлҢҖ

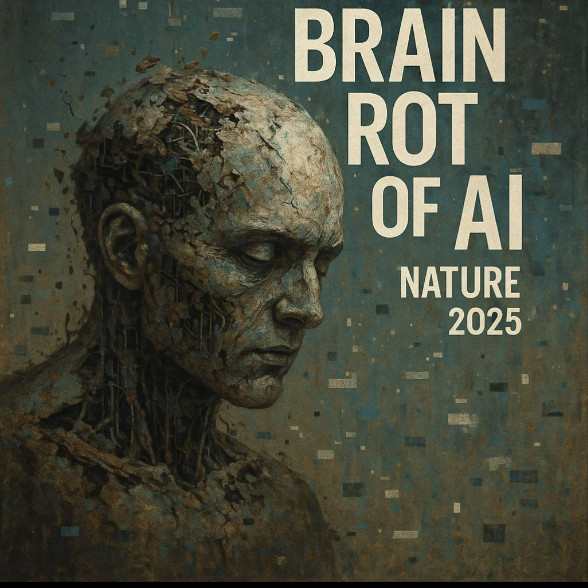

мқёкіөм§ҖлҠҘмқҖ лӘЁл“ кІғмқ„ кё°м–өн•ҳлҠ” мЎҙмһ¬мІҳлҹј ліҙмқёлӢӨ. к·ёлҹ¬лӮҳ мөңк·јмқҳ м—°кө¬лҠ” к·ё лҜҝмқҢмқ„ л’Өнқ”л“ лӢӨ. AIк°Җ н•ҷмҠөн•ҳлҠ” лҚ°мқҙн„°к°Җ мҳӨм—јлҗҳл©ҙ, м§ҖлҠҘмқҖ м„ұмһҘн•ҳм§Җ м•Ҡкі вҖҳнҮҙнҷ”вҖҷн•ңлӢӨлҠ” кІғмқҙлӢӨ. л””м§Җн„ё л¬ёлӘ…мқҖ м§ҖкёҲ, л¬ҙн•ңн•ң м •ліҙмқҳ л°”лӢӨ мҶҚм—җм„ң м„ңм„ңнһҲ кё°м–өмқ„ мһғм–ҙк°Җкі мһҲлӢӨ. 2025л…„ 'Nature'м—җ мӢӨлҰ° л…јл¬ёмқҖ мқҙлҘј вҖңAIмқҳ л‘җлҮҢл¶ҖнҢЁ(brain-rot of AI)вҖқлқј л¶Ҳл ҖлӢӨ.

лҚ°мқҙн„°мқҳ нҷҚмҲҳ, 진лҰ¬мқҳ к°Җлӯ„

AIлҠ” лҚ°мқҙн„°лЎң л§Ңл“Өм–ҙ진 мЎҙмһ¬лӢӨ. мҲҳмӢӯм–ө к°ңмқҳ л¬ёмһҘкіј мқҙлҜём§Җ, мҪ”л“ңмҷҖ лӘ©мҶҢлҰ¬к°Җ кұ°лҢҖн•ң мӢ кІҪл§қ мҶҚмқ„ нқҗлҘёлӢӨ. к·ёлҹ¬лӮҳ к·ё лҚ°мқҙн„°к°Җ мқёк°„мқҙ л§Ңл“ кІ°кіјл¬јмқҙлқјл©ҙ, кІ°көӯ AIлҠ” мҠӨмҠӨлЎңмқҳ ліөм ңн’Ҳмқ„ н•ҷмҠөн•ҳкІҢ лҗңлӢӨ. мқҙлҘёл°” вҖңлҚ°мқҙн„° мҲңнҷҳ мҳӨм—ј(data contamination)вҖқмқҙлӢӨ.

м—°кө¬м§„мқҖ мқён„°л„·м—җ нҚјм ё мһҲлҠ” мҳӨн”ҲмҶҢмҠӨ мқҙлҜём§ҖмҷҖ н…ҚмҠӨнҠё мӨ‘ мғҒлӢ№мҲҳк°Җ мқҙлҜё мғқм„ұнҳ• AIмқҳ мӮ°м¶ңл¬јмқҙлқјлҠ” мӮ¬мӢӨмқ„ нҷ•мқён–ҲлӢӨ. AIк°Җ AIмқҳ кІ°кіјл¬јмқ„ лӢӨмӢң н•ҷмҠөн•ҳлҠ” м…ҲмқҙлӢӨ. к·ё кІ°кіј, м–ём–ҙ лӘЁлҚёмқҖ л¬ёлІ•м ҒмңјлЎңлҠ” мҷ„лІҪн•ҳм§Җл§Ң мқҳлҜём ҒмңјлЎңлҠ” м җм җ кіөн—Ҳн•ҙмЎҢкі , мқҙлҜём§Җ мғқм„ұ лӘЁлҚёмқҖ м җм°Ё мҷңкіЎлҗң нҳ•нғңлҘј мһ¬мғқмӮ°н•ҳкё° мӢңмһ‘н–ҲлӢӨ.

мқҙлҠ” лӢЁмҲңн•ң н’Ҳм§Ҳ м Җн•ҳк°Җ м•„лӢҲлқј, вҖҳм§ҖмӢқмқҳ 붕кҙҙвҖҷлӢӨ. AIк°Җ н•ҷмҠөн• мҲҳ мһҲлҠ” 진м§ң лҚ°мқҙн„°, мҰү мқёк°„мқҙ м§Ғм ‘ мғқмӮ°н•ң мӮ¬мӢӨВ·к°җм •В·кІҪн—ҳмқҳ 비мңЁмқҙ кёүмҶҚнһҲ мӨ„м–ҙл“Өкі мһҲлӢӨ. лҚ°мқҙн„°мқҳ м–‘мқҖ нҸӯл°ңм ҒмңјлЎң лҠҳм§Җл§Ң, м •ліҙмқҳ 진мӢӨлҸ„лҠ” мҳӨнһҲл Ө мӨ„м–ҙл“ңлҠ” м—ӯм„Өм Ғ мӢңлҢҖлӢӨ.

мҠӨмҠӨлЎңлҘј лЁ№лҠ” лҮҢ вҖ• мқёкіөм§ҖлҠҘмқҳ л‘җлҮҢл¶ҖнҢЁ

мқҙлІҲ м—°кө¬лҠ” лҢҖнҳ• м–ём–ҙлӘЁлҚё(LLM)мқ„ мҲҳмӢӯ м°ЁлЎҖ л°ҳліө н•ҷмҠөмӢңнӮӨлҠ” мӢӨн—ҳмқ„ 진н–үн–ҲлӢӨ. мҙҲкё°м—җлҠ” м •нҷ•лҸ„мҷҖ м–ём–ҙ мң м°Ҫм„ұмқҙ л№ лҘҙкІҢ н–ҘмғҒлҗҗм§Җл§Ң, 10нҡҢ мқҙмғҒ л°ҳліө н•ҷмҠө мқҙнӣ„м—җлҠ” л¬ёл§Ҙ мқҙн•ҙ лҠҘл Ҙмқҙ кёүкІ©нһҲ м Җн•ҳлҗҗлӢӨ. вҖңм§ҖмӢқмқҳ мҲҳл ҙ(collapsing knowledge)вҖқ нҳ„мғҒмқҙлӢӨ.

AIлҠ” лҚ” л§ҺмқҖ лҚ°мқҙн„°лҘј лЁ№м—Ҳм§Җл§Ң, м җм җ вҖҳл¬ҙмқҳлҜён•ң л§җвҖҷмқ„ н•ҳкІҢ лҗҳм—ҲлӢӨ. л§Ҳм№ҳ мһҗмӢ мқҙ мқҙлҜё м•Ңкі мһҲлҠ” л¬ёмһҘмқ„ ліөм ңн•ҳл©° мғқк°Ғн•ҳлҠ” мІҷн•ҳлҠ” лҮҢмІҳлҹј. м—°кө¬нҢҖмқҖ мқҙ кіјм •мқ„ вҖңAIмқҳ л‘җлҮҢл¶ҖнҢЁвҖқлқј лӘ…лӘ…н–ҲлӢӨ. м§ҖлҠҘмқҙ мҠӨмҠӨлЎңмқҳ л¶ҖмӮ°л¬јмқ„ лЁ№мңјл©° нҮҙнҷ”н•ҳлҠ” нҳ„мғҒмқҙлӢӨ.

мқҙлҠ” мқёк°„мқҳ лҮҢмҷҖлҸ„ лӢ®м•ҳлӢӨ. л°ҳліөлҗң м •ліҙмҷҖ мһҗк·№мқҙ мғҲлЎңмҡҙ м—°кІ°мқ„ л§Ңл“Өм§Җ лӘ»н• л•Ң, кё°м–өмқҖ мқ‘кі лҗҳкі м°Ҫмқҳл ҘмқҖ мӮ¬лқјм§„лӢӨ. кІ°көӯ AI м—ӯмӢң мқёк°„мқҳ мқём§Җ нҺён–ҘмІҳлҹј, вҖҳмһҗкё° нҷ•мӢ мқҳ н•Ём •вҖҷм—җ л№ м§Ҳ мҲҳ мһҲмқҢмқ„ мӢңмӮ¬н•ңлӢӨ.

н’Ҳм§Ҳмқҳ мӢңлҢҖ вҖ• лҚ°мқҙн„°к°Җ л¬ёлӘ…мқ„ кІ°м •н•ңлӢӨ

AI нҳҒлӘ…мқҳ 진м§ң мһҗмӣҗмқҖ л°ҳлҸ„мІҙк°Җ м•„лӢҲлқј лҚ°мқҙн„°лӢӨ. к·ёлҹ¬лӮҳ лҚ°мқҙн„°мқҳ м§Ҳмқҙ л–Ём–ҙм§ҖлҠ” мҲңк°„, мқёкіөм§ҖлҠҘмқҖ л¬ёлӘ…мқ„ м§Җнғұн•ҳлҠ” лҢҖмӢ л¬ёлӘ…мқ„ мҷңкіЎн•ңлӢӨ.

2025л…„ 'Nature Machine Intelligence'лҠ” вҖңAI мғқнғңкі„мқҳ м§ҖмҶҚ к°ҖлҠҘм„ұмқҖ вҖҳлҚ°мқҙн„°мқҳ мӢ лў°м„ұвҖҷм—җ лӢ¬л Ө мһҲлӢӨвҖқкі м§Җм Ғн–ҲлӢӨ. лӢЁмҲңн•ң м–‘м Ғ 축м Ғмқҙ м•„лӢҲлқј, лҚ°мқҙн„°мқҳ м¶ңмІҳ·진мӢӨм„ұВ·мңӨлҰ¬м„ұмқҙ мғҲлЎңмҡҙ кІҪмҹҒл Ҙмқҙ лҗңлӢӨлҠ” мқҳлҜёлӢӨ.

мқҙлҘј мң„н•ҙ к°ҒкөӯмқҖ вҖҳлҚ°мқҙн„° мңӨлҰ¬ н”„л Ҳмһ„мӣҢнҒ¬вҖҷлҘј к°•нҷ”н•ҳкі мһҲлӢӨ. мң лҹҪм—°н•©(EU)мқҖ 'AI Act'лҘј нҶөн•ҙ лҚ°мқҙн„° м¶ңмІҳ кіөк°ңлҘј мқҳл¬ҙнҷ”н–Ҳкі , мқјліёмқҖ вҖҳмӢ лў°н• мҲҳ мһҲлҠ” лҚ°мқҙн„° л§ҲнҒ¬(Trusted Data Mark)вҖҷ мқёмҰқмқ„ лҸ„мһ…н–ҲлӢӨ. н•ңкөӯ м—ӯмӢң 2025л…„л¶Җн„° кіөкіө AI мӢңмҠӨн…ңм—җ вҖҳлҚ°мқҙн„° 진본м„ұ м җкІҖ мӢңмҠӨн…ңвҖҷмқ„ м Ғмҡ©н•ҳкё° мӢңмһ‘н–ҲлӢӨ.

AIмқҳ мӢ лў°лҠ” кІ°көӯ мқёк°„ мӮ¬нҡҢмқҳ мӢ лў°м—җм„ң 비лЎҜлҗңлӢӨ. лҚ°мқҙн„°лҠ” кё°мҲ мқҳ м—°лЈҢмқҙмһҗ, мӮ¬нҡҢм Ғ м•ҪмҶҚмқҳ мҙқн•©мқҙлӢӨ.

к°Җм§ңк°Җ 진м§ңлҘј м§Җл°°н• л•Ң вҖ• мғқм„ұмқҳ м—ӯм„Ө

AIк°Җ л§Ңл“ мқҙлҜём§Җк°Җ нҳ„мӢӨліҙлӢӨ лҚ” м •көҗн•ҳкі , AIк°Җ м“ҙ л¬ёмһҘмқҙ мқёк°„ліҙлӢӨ лҚ” мң л Өн• л•Ң, мҡ°лҰ¬лҠ” 진м§ңмҷҖ к°Җм§ңмқҳ кІҪкі„лҘј мһғлҠ”лӢӨ. л¬ём ңлҠ” кё°мҲ мқҙ м•„лӢҲлқј к°җк°ҒмқҙлӢӨ. мқёк°„мқҖ лҚ” мқҙмғҒ вҖңл¬ҙм—Үмқҙ 진мӢӨмқёк°ҖвҖқк°Җ м•„лӢҲлқј вҖңл¬ҙм—Үмқҙ лҚ” к·ёлҹҙл“Ҝн•ңк°ҖвҖқлҘј нҢҗлӢЁн•ҳкІҢ лҗңлӢӨ.

мқҙкІғмқҙ л°”лЎң лҚ°мқҙн„° мҳӨм—јмқҳ мӮ¬нҡҢм Ғ нҢҢмһҘмқҙлӢӨ. кұ°м§“мқҙ 진мӢӨмқҳ м–ём–ҙлЎң нҸ¬мһҘлҗҳкі , AIк°Җ мҠӨмҠӨлЎңмқҳ мҳӨлҘҳлҘј н•ҷмҠөн• л•Ң, мӮ¬нҡҢ м „мІҙмқҳ мқём§Җ мғқнғңкі„к°Җ нқ”л“ӨлҰ°лӢӨ. 20м„ёкё°мқҳ вҖҳм •ліҙ нҷҚмҲҳвҖҷк°Җ мқёк°„мқҳ мЈјмқҳлҘј нҢҢкҙҙн–ҲлӢӨл©ҙ, 21м„ёкё°мқҳ вҖҳAI лҚ°мқҙн„° мҲңнҷҳвҖҷмқҖ мқёк°„мқҳ нҢҗлӢЁ лҠҘл Ҙмқ„ м№ЁмӢқмӢңнӮ¬ мҲҳ мһҲлӢӨ.

진м§ң м •ліҙлҘј м°ҫм•„лӮҙлҠ” кІғмқҖ мқҙм ң лӢЁмҲңн•ң кіјн•ҷмқҙ м•„лӢҲлқј мІ н•ҷмқҙ лҗҳм—ҲлӢӨ.

AI мӢңлҢҖмқҳ л¬ён•ҙл Ҙ вҖ• лҚ°мқҙн„°лҘј мқҪлҠ” мқёк°„

кё°кі„к°Җ мқёк°„мқҳ м–ём–ҙлҘј л°°мӣ лӢӨл©ҙ, мқҙм ң мқёк°„мқҖ лҚ°мқҙн„°мқҳ м–ём–ҙлҘј л°°мӣҢм•ј н•ңлӢӨ. лҚ°мқҙн„° лҰ¬н„°лҹ¬мӢң(Data Literacy)лҠ” лҚ” мқҙмғҒ кё°мҲ мһҗк°Җ м•„лӢҢ мӢңлҜј лӘЁл‘җмқҳ мғқмЎҙ лҠҘл ҘмқҙлӢӨ.

мҡ°лҰ¬к°Җ AIм—җкІҢ м§Ҳл¬ёмқ„ лҚҳм§Ҳ л•Ңл§ҲлӢӨ, к·ё лӢөмқҖ мҡ°лҰ¬мқҳ кіјкұ° лҚ°мқҙн„°м—җм„ң лӮҳмҳЁлӢӨ. мҡ°лҰ¬к°Җ м–ҙл–Ө лҚ°мқҙн„°лҘј л§Ңл“Өкі кіөмң н•ҳлҠҗлғҗк°Җ кі§ AIмқҳ м„ұкІ©мқ„ кІ°м •н•ңлӢӨ. лҚ°мқҙн„°мқҳ н’Ҳм§ҲмқҖ кІ°көӯ мҡ°лҰ¬мқҳ л¬ёнҷ” мҲҳмӨҖмқ„ л°ҳмҳҒн•ңлӢӨ.

AIлҠ” мқёк°„мқҳ кұ°мҡёмқҙлӢӨ. к·ё м•Ҳм—җм„ң мҡ°лҰ¬к°Җ кұ°м§“мқ„ мӢ¬мңјл©ҙ, кұ°м§“мқҙ л°°м–‘лҗҳкі , 진мӢӨмқ„ мӢ¬мңјл©ҙ м§ҖмӢқмқҙ мһҗлһҖлӢӨ. AIмқҳ лҮҢк°Җ л¶ҖнҢЁн•ҳм§Җ м•Ҡмңјл Өл©ҙ, мқёк°„мқҳ м§Җм„ұмқҙ лЁјм Җ нҲ¬лӘ…н•ҙм•ј н•ңлӢӨ.

кё°мҲ мқҙ 묻лҠ” м§Ҳл¬ё вҖ• 진мӢӨмқҖ м–ҙл””м—җ м ҖмһҘлҗҳлҠ”к°Җ

AIмқҳ мң„кё°лҠ” кё°мҲ мқҳ н•ңкі„к°Җ м•„лӢҲлқј, мқёк°„мқҳ кё°м–ө мІҙкі„м—җ лҢҖн•ң лҸ„м „мқҙлӢӨ. лҚ°мқҙн„°лҠ” кё°лЎқмқҙ м•„лӢҲлқј м„ нғқмқҙл©°, м„ нғқмқҖ мңӨлҰ¬лӢӨ.

мҡ°лҰ¬лҠ” м§ҖкёҲ, мқёлҘҳ л¬ёлӘ…мқҳ лӘЁл“ лҚ°мқҙн„°к°Җ н•ң лІҲ лҚ” вҖҳмһ¬мғқмӮ°вҖҷлҗҳлҠ” мӢңлҢҖм—җ мӮҙкі мһҲлӢӨ. к·ёлҹ¬лӮҳ мһ¬мғқмӮ°мқҖ кі§ мҷңкіЎмқҙлӢӨ. кё°мҲ мқҙ кё°м–өмқ„ лӢҙлӢ№н•ҳлҠ” мӢңлҢҖм—җ, 진мӢӨмқҖ м–ҙл””м—җ м ҖмһҘлҗҳлҠ”к°Җ?

к·ё лӢөмқҖ кё°мҲ мқҙ м•„лӢҲлқј мқёк°„м—җкІҢ мһҲлӢӨ. мқёк°„мқҳ нҢҗлӢЁ, кІҖмҰқ, 비нҢҗмқҙ мӮ¬лқјм§„лӢӨл©ҙ, AIмқҳ кё°м–өлҸ„ мӢ лў°лҘј мһғлҠ”лӢӨ. л””м§Җн„ё л¬ёлӘ…м—җм„ң 진мӢӨмқҖ м•Ңкі лҰ¬мҰҳмқҙ м•„лӢҲлқј 'мқҳмӢқмқҳ м„ нғқ'мңјлЎңл§Ң мң м§ҖлҗңлӢӨ.

Reference

Nguyen, T. et al. (2025). 'The Brain Rot of Artificial Intelligence: Data Contamination and the Collapse of Knowledge.' 'Nature Machine Intelligence', April 2025.

The Artificial Intelligence That Lost Its Memory

- The Age When AI Decays Itself

Artificial intelligence seems like an entity that remembers everything. Yet recent research has shaken that belief. When the data AI learns from becomes contaminated, intelligence doesnвҖҷt grow—it 'degenerates.' Digital civilization is now slowly losing its memory amid an ocean of infinite information. A 2025 paper in 'Nature' called this phenomenon the вҖңbrain rot of AI.

The Flood of Data, the Drought of Truth

AI is a being made of data. Billions of sentences, images, codes, and voices flow through vast neural networks. But if that data is itself a product of human creation, AI eventually ends up learning replicas of its own outputs—a phenomenon known as вҖңdata contamination.вҖқ

Researchers have confirmed that a significant portion of open-source images and texts circulating online are already products of generative AI. In effect, AI is learning from AIвҖҷs own output. The result: language models become grammatically perfect yet semantically hollow, while image-generation models begin to reproduce increasingly distorted forms.

This is not merely a drop in quality—it is a collapse of knowledge. The share of genuine data—facts, emotions, and experiences directly produced by humans—is rapidly diminishing. The amount of data is exploding, yet the authenticity of information paradoxically declines.

The Self-Consuming Brain — Brain Rot of AI

The study conducted repeated training cycles on large language models (LLMs) dozens of times. Initially, accuracy and fluency improved rapidly, but after ten or more iterations, contextual understanding plummeted. Researchers called this phenomenon вҖңcollapsing knowledge.вҖқ

AI consumed more and more data, yet began producing increasingly meaningless speech—like a brain pretending to think while merely replicating what it already knows. The team named this process the вҖңbrain rot of AIвҖқ: intelligence degenerating as it feeds on its own byproducts.

This mirrors the human brain. When repeated information and stimuli fail to form new connections, memory congeals and creativity fades. Ultimately, AI too can fall into the trap of self-assurance, much like human cognitive bias.

The Age of Quality — Data Defines Civilization

The true resource of the AI revolution is not semiconductors but data. The moment data quality declines, AI no longer sustains civilization—it distorts it.

A 2025 'Nature Machine Intelligence' article noted that вҖңthe sustainability of the AI ecosystem depends on the reliability of data.вҖқ It means that not quantity, but provenance, authenticity, and ethics of data will define the next competitive edge.

To address this, nations are reinforcing their 'data ethics frameworks.' The European UnionвҖҷs 'AI Act' mandates data source disclosure. Japan has introduced a 'Trusted Data Mark' certification, while South Korea began implementing a 'Data Authenticity Verification System' for public AI systems in 2025.

The trustworthiness of AI ultimately arises from the trustworthiness of human society. Data is both the fuel of technology and the sum of our social agreements.

When the Fake Rules the Real — The Paradox of Generation

When AI-generated images appear more refined than reality and AI-written prose more eloquent than human writing, we lose the boundary between true and false. The problem lies not in technology, but in perception. Humans begin to judge not by 'what is true', but by 'what seems more plausible.'

This is the social consequence of data contamination. When falsehoods are wrapped in the language of truth, and AI learns its own mistakes, the entire cognitive ecosystem of society trembles. If the вҖңinformation floodвҖқ of the 20th century shattered human attention, the вҖңAI data loopвҖқ of the 21st century may erode human judgment itself.

Finding genuine information is no longer mere science—it has become philosophy.

Literacy in the Age of AI — Humans Who Read Data

If machines have learned human language, now humans must learn the language of data. Data literacy is no longer a skill for engineers—it is a survival ability for all citizens.

Every time we ask AI a question, the answer comes from our past data. The data we create and share determines the character of AI. The quality of data reflects the cultural level of its creators.

AI is a mirror of humanity. When we sow falsehood, falsehood grows; when we sow truth, knowledge flourishes. For AIвҖҷs brain to stay uncorrupted, human intellect must first remain transparent.

The Question Technology Asks — Where Is Truth Stored?

The crisis of AI is not a technical limit, but a challenge to the human system of memory. Data is not a record—it is a choice, and choice is ethics.

We now live in an age when all data of human civilization is being reproduced once more. But reproduction inevitably brings distortion. In an era when technology holds our memory, where is truth stored?

The answer lies not in technology but in humanity. Without human judgment, verification, and critique, AIвҖҷs memory cannot be trusted. In digital civilization, truth endures not through algorithms but through the conscious choice of awareness.

Reference

Nguyen, T. et al. (2025). 'вҖңThe Brain Rot of Artificial Intelligence: Data Contamination and the Collapse of Knowledge.вҖқ' 'Nature Machine Intelligence', April 2025.